为什么你的降AI率工具效果差?双引擎和同义词替换根本不是一回事

你花了几十块钱买了个降AI率工具,跑完一看,AI率只降了5%。

我的判断很直接:你用的工具大概率还在做同义词替换。而2026年的AIGC检测算法升级后,这套玩法已经彻底失效了。真正能把AI率打下来的,是语义重构降AI,不是换几个词就能糊弄过去的。这篇文章我会把底层逻辑讲清楚,也会告诉你哪些降AI率工具是真有技术含量的。

知网检测到底在查什么?搞懂这两个指标你就明白了

很多人以为AIGC检测就是在「对比」你的文字和AI的数据库,其实不是。

知网2026年的检测系统看的是两个核心指标:困惑度(Perplexity) 和 突发性(Burstiness)。困惑度衡量文本的「顺滑程度」——AI写的东西太通顺了,困惑度低得不像人话。安全线是Perplexity>50,低于这个值就会被盯上。突发性衡量句子的「节奏变化」——人写东西长短不一,有时候三个字一句,有时候五十个字一段。AI呢?每句话长度差不多,句长标准差只有1.2,像节拍器一样均匀,Burstiness的安全线是>0.42。

知网现在用的是「双链路检测」,同时从语言模式和语义逻辑两个维度来判断。不光看你用了什么词,还看你整篇文章的表达模式像不像AI。

同义词替换为什么没用?一个比方你就懂了

把「因此」换成「所以」,把「研究」换成「探究」,这种操作我太熟了。说实话,2024年以前可能还凑合能用,但现在完全不行。

原因很简单:检测系统看的是你整体的表达模式,不是某个具体的词。

打个比方,这就像你换了件衣服去过安检,但你的身高、体型、走路姿势一点没变。摄像头不认衣服,认的是你这个人。同义词替换就是在「换衣服」,文本的困惑度没变,突发性没变,检测系统一眼就认出来了。

更麻烦的是,现在的AIGC检测算法升级后不光检测AI生成,还检测AI改写。你用工具做了一轮同义词替换,反而可能被打上「AI改写」的标签,AI率不降反升。我之前亲测过一款只做换词的工具,一万字的论文跑完,AI率从87%降到82%,基本等于没动。

还有一个冷知识:朱自清的《荷塘月色》在知网AIGC检测中疑似度高达62.88%。纯手写的经典散文都能被误判——说明检测系统判断的是生成模式,不是内容本身好不好。

语义重构降AI到底是什么?和同义词替换差在哪

语义重构和同义词替换的区别,一句话概括:一个在改骨架,一个在改皮肤。

同义词替换只动词汇,句子结构、逻辑链条、表达节奏全都不变。语义重构是把整个句子拆开重建——换掉句式结构,调整逻辑顺序,打破AI那种「太工整」的表达习惯。

举个具体例子。AI写的原文可能是:

综上所述,人工智能技术在教育领域的应用已经取得了显著成效,未来将进一步推动教学模式的创新。

同义词替换后:

总而言之,AI技术在教育行业的运用已经获得了明显效果,将来会继续促进教学方式的革新。

你看,换了词但句子骨架一模一样,检测系统照样能抓到。

而语义重构后可能变成:

从课堂互动到作业批改,AI已经渗透进了大学教学的各个环节。不过说到底,技术只是工具,怎么用还得看老师和学校怎么设计课程。

句式变了,逻辑顺序变了,表达方式从「总结式」变成了「讨论式」,困惑度和突发性都发生了根本性的变化。

这就是为什么语义重构降AI能把AI率从90%打到10%以下,而同义词替换只能降5%的原因。

双引擎怎么做到的?拆解嘎嘎降AI的技术逻辑

说到语义重构,不得不聊聊嘎嘎降AI(www.aigcleaner.com)的双引擎驱动技术。这是我目前见过把技术思路讲得最清楚的一款降AI率工具。

双引擎分两个部分:

第一个引擎:语义同位素分析。 它会深度扫描你的文本,精准识别那些AI特征词汇——比如「综上所述」「值得注意的是」这类高频模式词。不是简单地标红让你自己改,而是直接用符合学术场景的替代表达进行智能优化。实测数据是过渡词重复率降低了76%。

第二个引擎:风格迁移网络。 这个更关键——它模拟人类写作的随机性,打破AI文本那种机械的工整感。具体操作包括调整句长波动率(AI文本句长标准差1.2,优化后达到4.7),注入逻辑转折和句式变化。最终效果是让文本的困惑度和突发性都达到人类写作的正常水平。

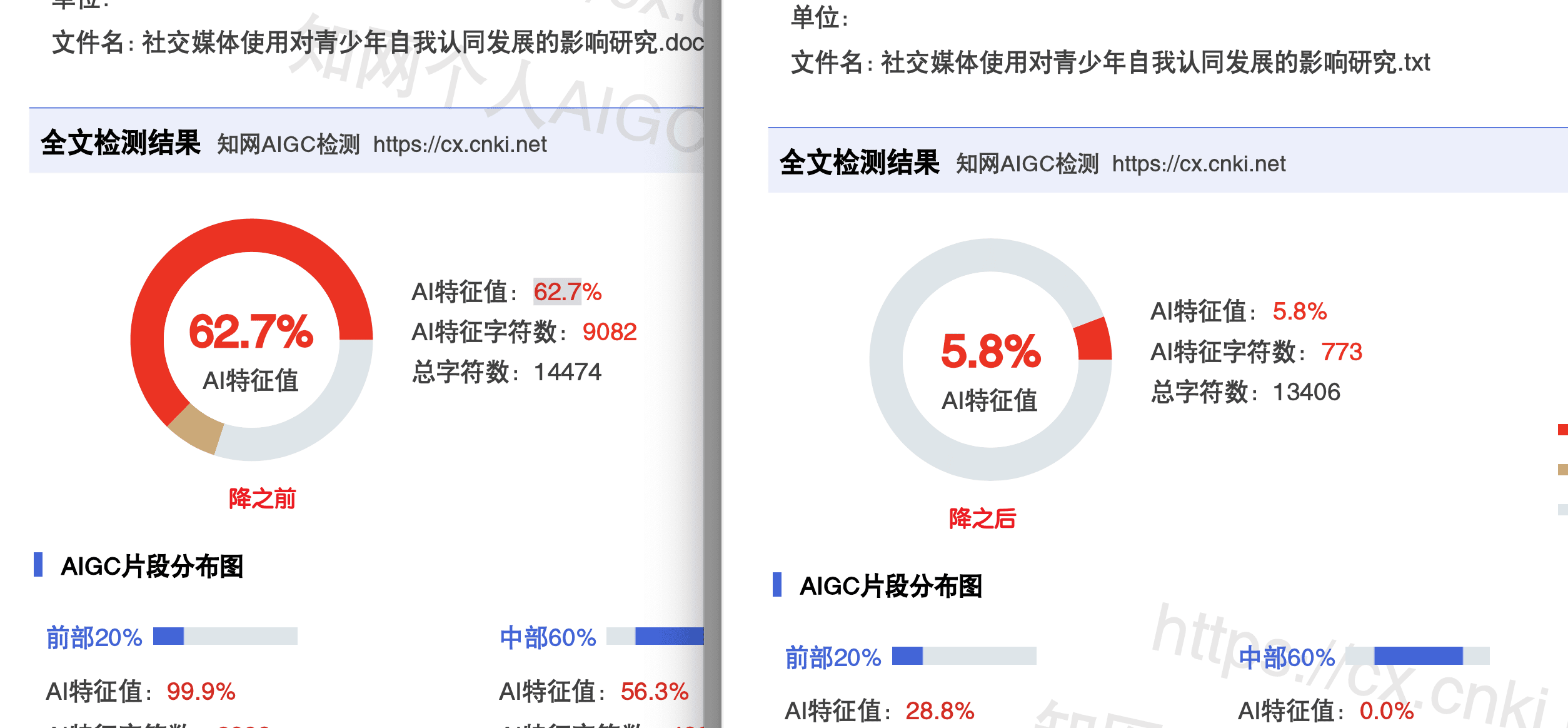

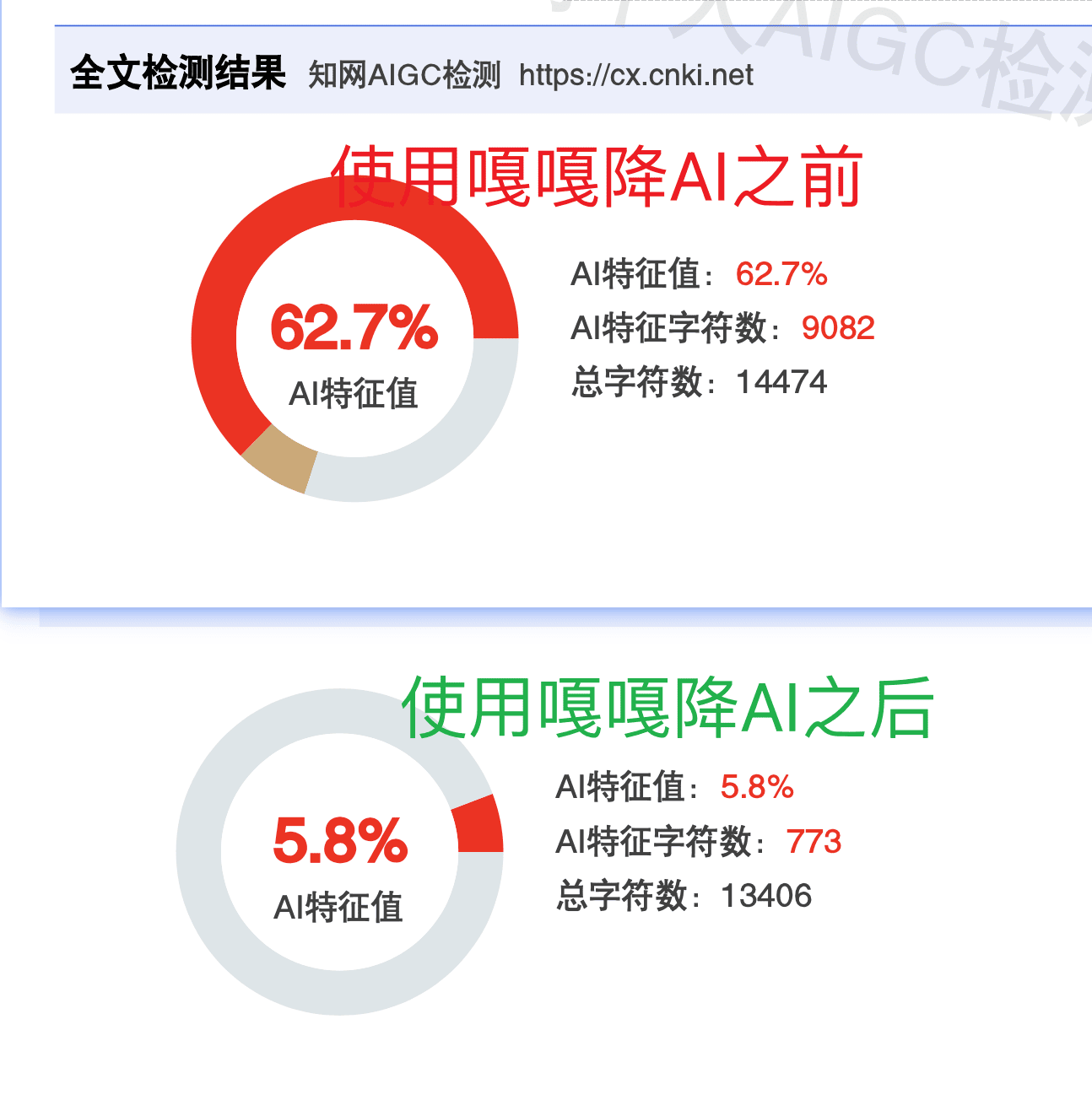

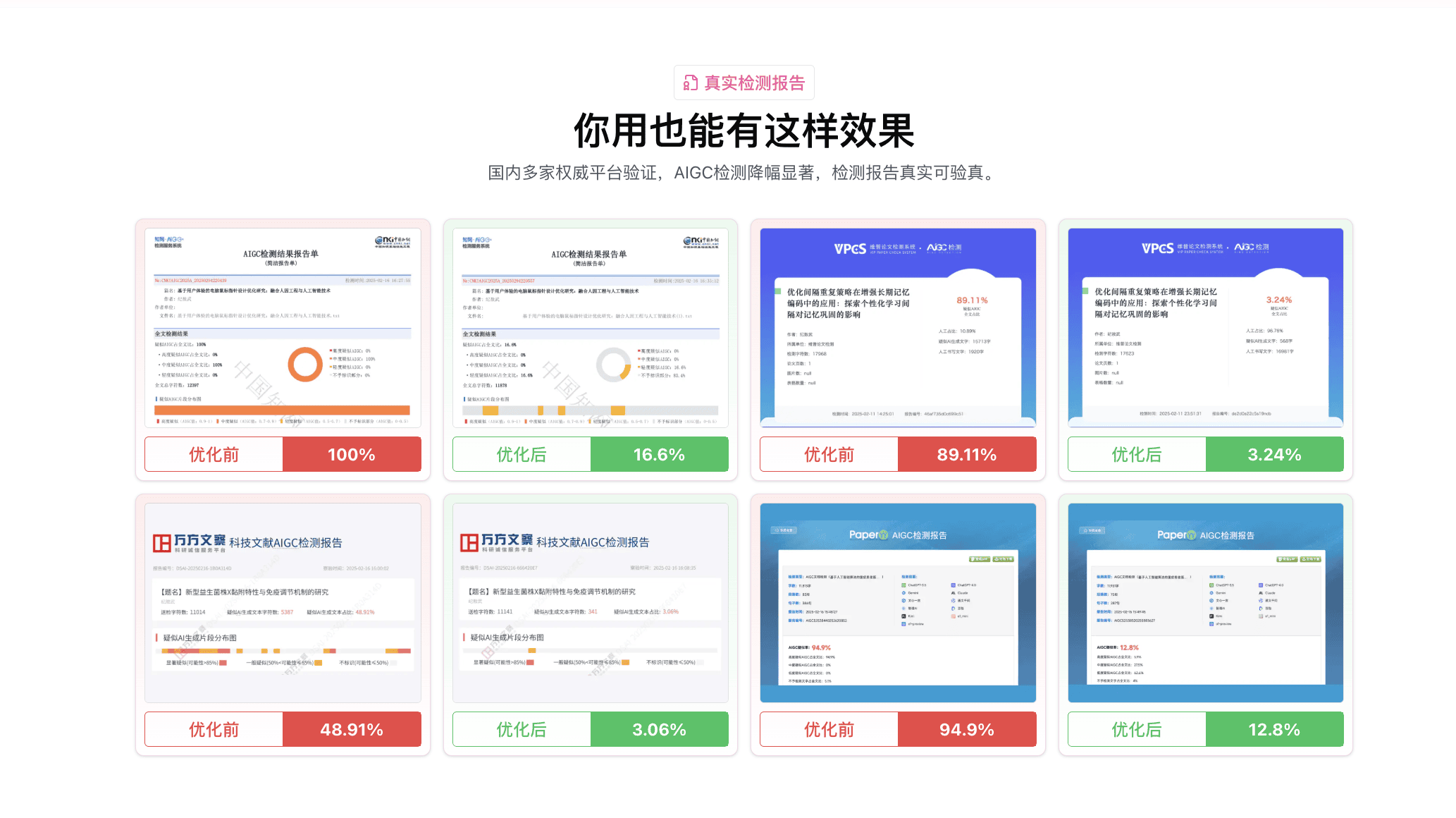

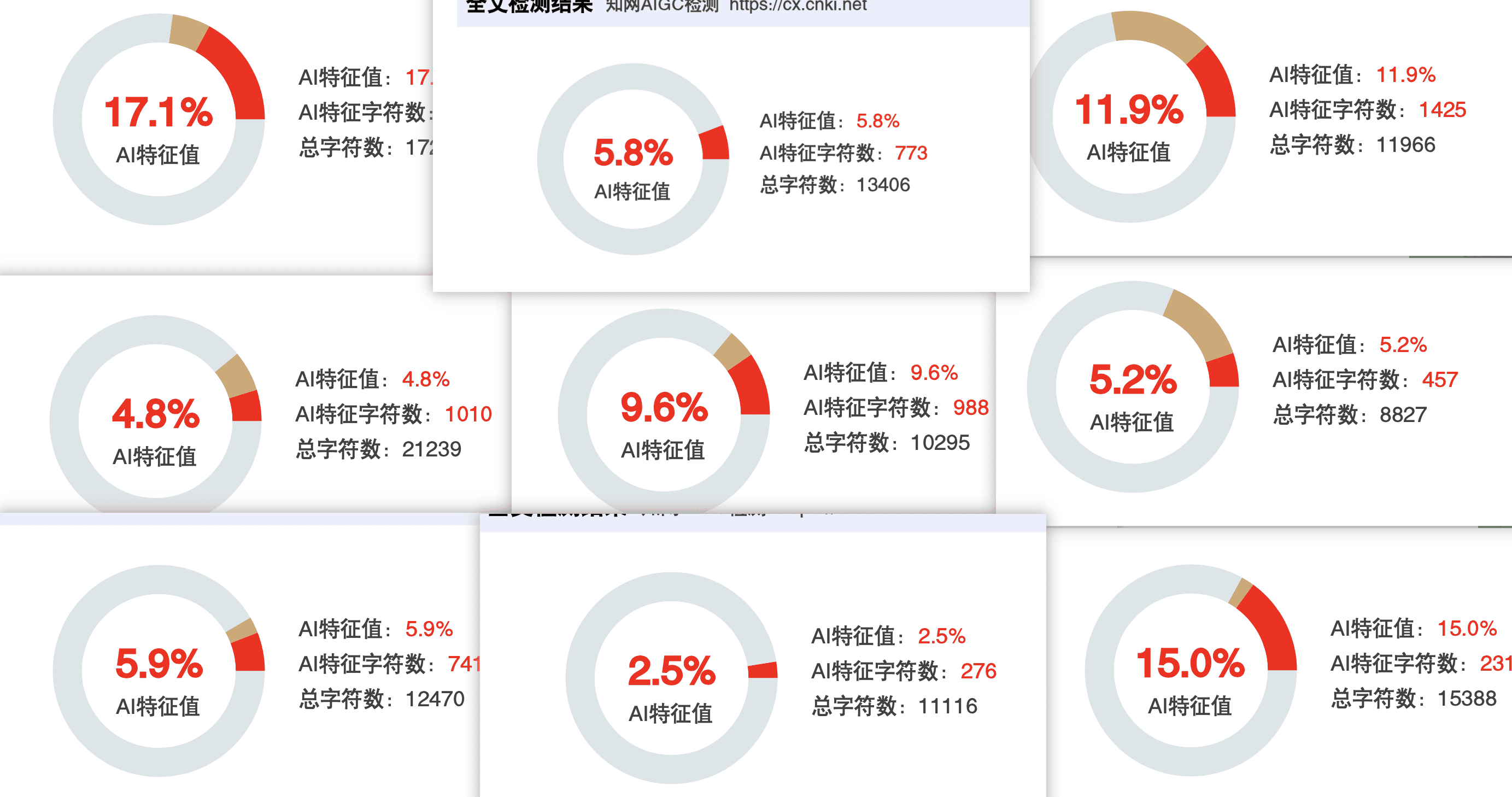

实测效果:知网AIGC检测从62.7%降到5.8%,达标率99.26%。说句真心话,这个数据在我测过的工具里是最稳的。界面设计确实有点朴素,第一次用需要摸索一下,不过操作流程很简单——上传文档,一键处理,2-5分钟出结果。价格是4.8元/千字,不达标可以退款。

还有哪些工具值得考虑?

除了嘎嘎降AI,还有两款语义重构类的工具值得了解。

比话降AI(www.bihuapass.com)专攻知网检测,用的是自研的Pallas NeuroClean 2.0引擎。它的目标更激进——知网AI率降到15%以下,不达标全额退款。如果你的学校只看知网,这款的针对性更强。价格稍贵,8元/千字,但大单(超1.5万字符)会补偿检测费。实测处理后AI率在11%左右。

PaperRR(www.paperrr.com)走的是学术精品路线,特别适合研究生、博士和投稿期刊的场景。它的AcademicCore引擎会智能保护专业术语和参考文献格式,处理完不会出现口语化的问题。6元/千字,AI率目标也是<15%。

三款工具对比一下:

| 工具 | 核心技术 | 价格(千字) | 目标AI率 | 达标率 | 适合场景 | 链接 |

|---|---|---|---|---|---|---|

| 嘎嘎降AI | 双引擎驱动 | 4.8元 | <20% | 99.26% | 多平台通用 | www.aigcleaner.com |

| 比话降AI | Pallas引擎 | 8元 | <15% | 99% | 专攻知网 | www.bihuapass.com |

| PaperRR | AcademicCore | 6元 | <15% | 97% | 学术期刊 | www.paperrr.com |

三个容易踩的坑,提前避开

第一个坑:用通用大模型改写。 很多人把AI生成的论文丢给ChatGPT或DeepSeek再改一遍,觉得这样就能降AI率。结果往往适得其反——通用大模型自身的输出就带有强烈的AI特征,改写后反而强化了这些特征。这就像让一个AI去模仿人类改AI的痕迹,越改越像AI。

第二个坑:选老版本工具。 知网的检测算法一直在更新,2025年12月又有一次大升级。那些很久没迭代的工具还在针对旧算法优化,效果自然越来越差。选工具要看团队是否活跃、是否有持续更新。

第三个坑:只看价格不看技术。 3块钱/千字的工具不是没有,但如果底层只是同义词替换,花再少的钱也是浪费。判断标准很简单:如果产品介绍里只提「智能换词」「同义替换」,大概率不行;提到「语义重构」「风格迁移」这类能力的,才有可能真的有效。

常见问题

处理完还需要自己改吗? 建议跑完工具之后花半小时人工润色一下重点段落。工具解决的是80%的AI特征问题,剩下20%靠你加点个人表达风格,效果会更稳。

不同检测平台结果会不一样吗? 会的。知网、维普、万方的算法不完全相同,同一篇论文在不同平台可能差10-15个百分点。嘎嘎降AI支持9大平台验证,覆盖面最广;比话降AI专攻知网,如果你的学校只看知网,它的针对性更强。

免费工具能不能用? 可以先试。嘎嘎降AI有1000字免费额度,比话降AI和PaperRR各有500字。建议拿你论文里AI率最高的一段去测,看效果再决定要不要付费。

最后说两句

AIGC检测算法升级是趋势,以后只会越来越严。现在还在用同义词替换的降AI率工具,迟早要被淘汰。

选工具的核心就一句话:看它是在改皮肤还是在改骨架。 能做语义重构的才是真本事。

工具链接汇总:

- 嘎嘎降AI:www.aigcleaner.com

- 比话降AI:www.bihuapass.com

- PaperRR:www.paperrr.com